Acercándome a la física aplicada

Y pensando en como podría ser mi ocaso profesional

Por fin, se acabaron los exámenes del primer cuatrimestre. No me puedo quejar. Me ha ido bastante bien. Posiblemente ha sido uno de los mejores cuatrimestres que he tenido, a pesar de que las asignaturas no eran precisamente sencillas: Mecánica de Fluidos, Óptica Física y Física de Materiales. Con esto me voy acercando, paso a paso, a mi objetivo de poder decir oficialmente que soy físico. Ahora bien, lo de terminar ejerciendo como tal ya es otra historia. Ya veremos.

Como suele pasar, apenas termina un cuatrimestre, empieza el siguiente. Esta vez voy a matricularme en una asignatura más de las tres que suelo cursar habitualmente. Mi idea es aprovechar la convocatoria de septiembre para quitarme otra materia de encima y poder plantearme seriamente terminar la carrera el año que viene. Las asignaturas que me tocan ahora son: Astrofísica, Geofísica y Fuentes de Energía, Programación Avanzada y Cuántica, y Meteorología y Climatología. Deseadme suerte, porque se viene un cuatrimestre (y verano) intenso.

También es cierto que las asignaturas del último año van resultando un poco más sencillas. Hay mucho más bagaje acumulado y cuesta menos afianzar los conceptos. Después de haber cursado el año pasado las dos asignaturas de cuántica y la asignatura de cosmología, con su buen álgebra tensorial y sus espacios no euclidianos, que te revientan la cabeza, lo que va quedando es más “fácil” de digerir. No hay que relajarse, pero asustan menos.

Lo interesante, al ojear el programa de estas cuatro asignaturas, es que dos de ellas —Programación Avanzada y Cuántica, y Meteorología y Climatología— tienen un componente computacional importante. En general, en muchas de las asignaturas del grado, si el plan de estudios es moderno, hay una buena parte de computación. Y es lógico porque la mayoría de la física actual se hace más con ordenadores y menos con tiza y pizarra. Asignaturas como Cálculo Numérico enseñan a resolver ecuaciones diferenciales numéricamente, a aproximar funciones, a extrapolar datos y a realizar regresiones, entre otras cosas.

La diferencia con estas dos asignaturas es que van un paso más allá del clásico script de Python para realizar una simulación. Tratan con mayor profundidad la realidad de la necesidad de computación en la física moderna. Se presentan situaciones en las que el volumen de datos es tan grande que no cabe en la memoria de un ordenador convencional, o en las que la complejidad de los cálculos impide obtener resultados en un tiempo razonable sin recurrir al paralelismo. Y que, por lo tanto, son necesarias otras técnicas mucho más avanzadas para resolver problemas numéricos.

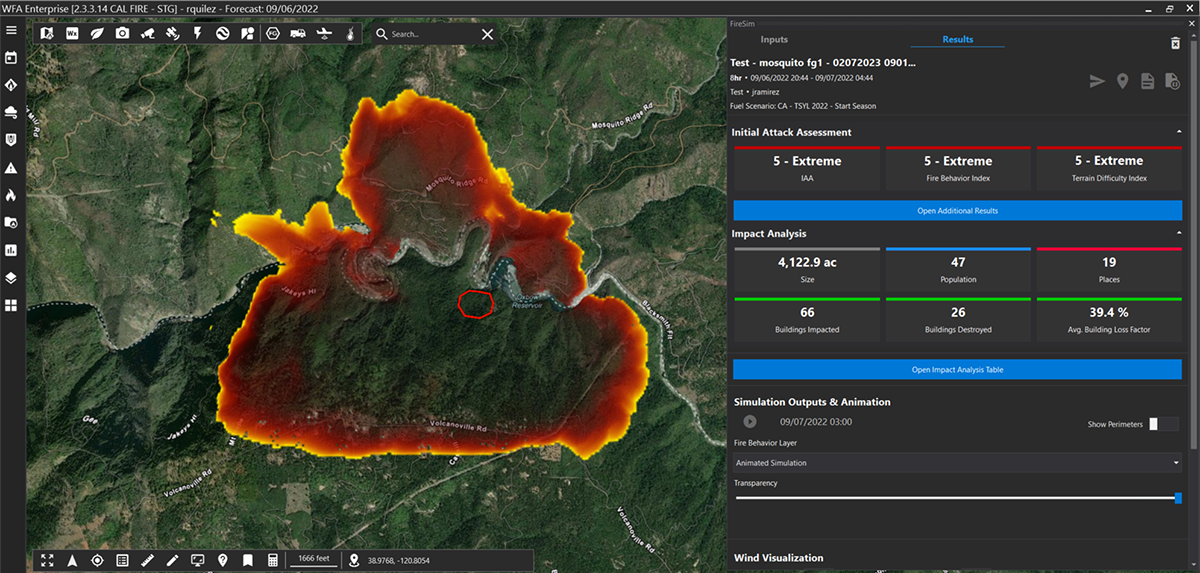

Aunque se pase un poco “de puntillas” por estos temas tan complejos, me parece fundamental que se nos presente esta realidad. Que además es una realidad que conozco, porque es exactamente lo que me encuentro a diario en Technosylva, la empresa donde trabajo. Nos dedicamos principalmente a la ciencia del fuego. El volumen de datos que nuestros modelos matemáticos requieren para operar es enorme. Para procesar esta información a escala no basta con un ordenador doméstico potente. Necesitamos superordenadores o clústeres de computación (conjuntos de cientos o miles de nodos que trabajan en paralelo).

Estamos hablando de gestionar datos a escala de terabytes y petabytes, y de hacerlo en tiempos relativamente cortos: minutos, horas o días (según la complejidad). Para que os hagáis una idea, en Technosylva lanzamos millones de simulaciones de incendios cada día, lo que nos permite calcular el riesgo de incendio en tiempo real para nuestros clientes. Para eso necesitamos un hardware a la altura y un software que sepa aprovecharlo al máximo.

Para poner estas cifras en perspectiva, siempre miro al LHC (Gran Colisionador de Hadrones) del CERN. Es probablemente la mayor fábrica de datos del mundo, con detectores que generan del orden de 1 petabyte por segundo. Obviamente, no hay sistema de almacenamiento que aguante ese ritmo, por lo que utilizan sistemas de filtrado en tiempo real que descartan casi el 99% de los datos, quedándose 'solo' con unos 30 petabytes de datos por año y acumulan ya exabytes de datos históricos. Si tienes curiosidad, el CERN tiene un Grafana público con información sobre la capacidad actual de su centro de datos. A día de hoy:

11180 servidores

+680k procesadores, +376k cores

+210k discos

1.32 exabytes (o 1.32M de TB) en cintas

+300k batch jobs simultaneous

Esa es la liga en la que hoy en día juega la física de vanguardia.

En Technosylva, el año pasado estrenamos un nuevo superordenador (HPC - High Performance Computing) con más de 15000 núcleos, que se suma a la infraestructura de superordenadores que ya teníamos. Podéis imaginar el coste de una inversión así. Para amortizarlo, la máquina debe estar a pleno rendimiento prácticamente las 24 horas del día, ya sea realizando investigaciones internas o ejecutando millones de simulaciones complejas para nuestros clientes.

Yo no me dedico personalmente a la parte científica, así que no “disfruto” directamente de ese maquinón. Pero los que diseñan los modelos y corren esas simulaciones son precisamente matemáticos y físicos. Por suerte, hoy mis conocimientos me permiten comprender cómo funcionan estos modelos y la complejidad que entrañan.

Por simplificar un poco, desde un punto de vista matemático, muchas ecuaciones diferenciales que modelan fluidos, la dinámica meteorológica, la onda de una partícula, etc., no tienen solución analítica sencilla. En algunos casos, se simplifican aspectos (fricción, compresibilidad, viscosidad, etc.) que pueden no tener un impacto muy grande en el resultado, ya que la incertidumbre del propio sistema sea mayor, aunque se pierda precisión. Por ejemplo, si unos términos de una ecuación son del orden de 10^8 y otros del orden de 10^2, puedo quitar los términos pequeños e inducir un error o incertidumbre en el resultado, lo cual, en muchos casos, no varía el comportamiento que quiero modelar. Y aun así, algunas ecuaciones simplificadas siguen sin tener una solución analítica sencilla.

Lo que si podemos, para que nos sean útiles estas ecuaciones para resolver problemas, es aplicar métodos numéricos, que es básicamente dado un valor inicial (una condición que se da en un punto del espacio), resolver numéricamente la ecuación en ese punto. Y, con el resultado obtenido, volver a iterar sobre los puntos adyacentes. Cuanto más preciso sea el resultado, más aumentaremos la resolución. Es decir, la distancia entre los puntos a calcular será menor y, por tanto, habrá que procesar un mayor número de puntos. Y este es, a grosso modo, el problema y la necesidad de la alta capacidad de computación.

Por eso creo que es tan valioso que un estudiante de física tenga, al menos, una introducción a este tipo de infraestructuras y arquitecturas de software, porque es lo que se va a encontrar en el mundo laboral si decides optar por la física aplicada, por ejemplo. Tener esta base permite a los futuros graduados saber qué les espera y cómo prepararse para el entorno laboral real si quieren dejar la academia.

Mientras tanto, Technosylva sigue creciendo. Ya disponemos de nuestros propios modelos meteorológicos y estamos ampliando horizontes más allá de la ciencia del fuego, desarrollando modelos para otras catástrofes como inundaciones, terremotos o huracanes. Así que es un lujo experimentar tan de cerca la física aplicada, aunque sea desde el ámbito de la ingeniería.

Yo, de momento, me quedo en mi parcela, la ingeniería de plataformas, que es lo que llevo años puliendo y lo que me hace competente en mi día a día. Sin embargo, espero que todo este esfuerzo en la carrera me sirva para empatizar mejor con mis compañeros de ciencia y entender el “porqué” de lo que hacen. ¿Y quién sabe? Con 15 o 20 años de carrera profesional por delante, igual termino haciendo mis pinitos en el lado científico y termino de rizar el rizo. ¿Y publicar algún paper?

Ya veremos. De momento, a seguir aprendiendo y disfrutando del camino.

¡Muchas gracias por leerme!